エンタープライズ アーティストの天見です。

今回は、国内にある最新のインカメラVFXスタジオ「Hibino VFX Studio」にてヒストリアの技術デモのCutting-Edge Test Driveを使ってのバーチャルプロダクションの検証をメタバース プロダクションの方々とHIBINOさんのスタジオで行いました。

LED Wallを使ったインカメラVFXのバーチャルプロダクションとは

Disney+チャンネルから配信になった「スター・ウォーズ」のスピンオフ作品の「マンダロリアン」で有名になった、背景をLEDで囲むように配置してそこにUnreal EngineなどのリアルタイムCGや映像を表示し、カメラの動きに合わせて3Dのパースを調整することで背景として撮影する手法です。

グリーンバック撮影と異なり、LEDからの環境光の反射などを活用でき、リアルタイムに背景と役者の合成した映像を確認しながら撮影ができるなど様々なメリットがあります。

東京都港区湾岸2-7-70 ヒビノ日の出ビル3F

最寄り駅:ゆりかもめ日の出駅/JR田町駅/JR浜松町駅など

Hibino VFX Studio

バーチャルプロダクションスタジオ。

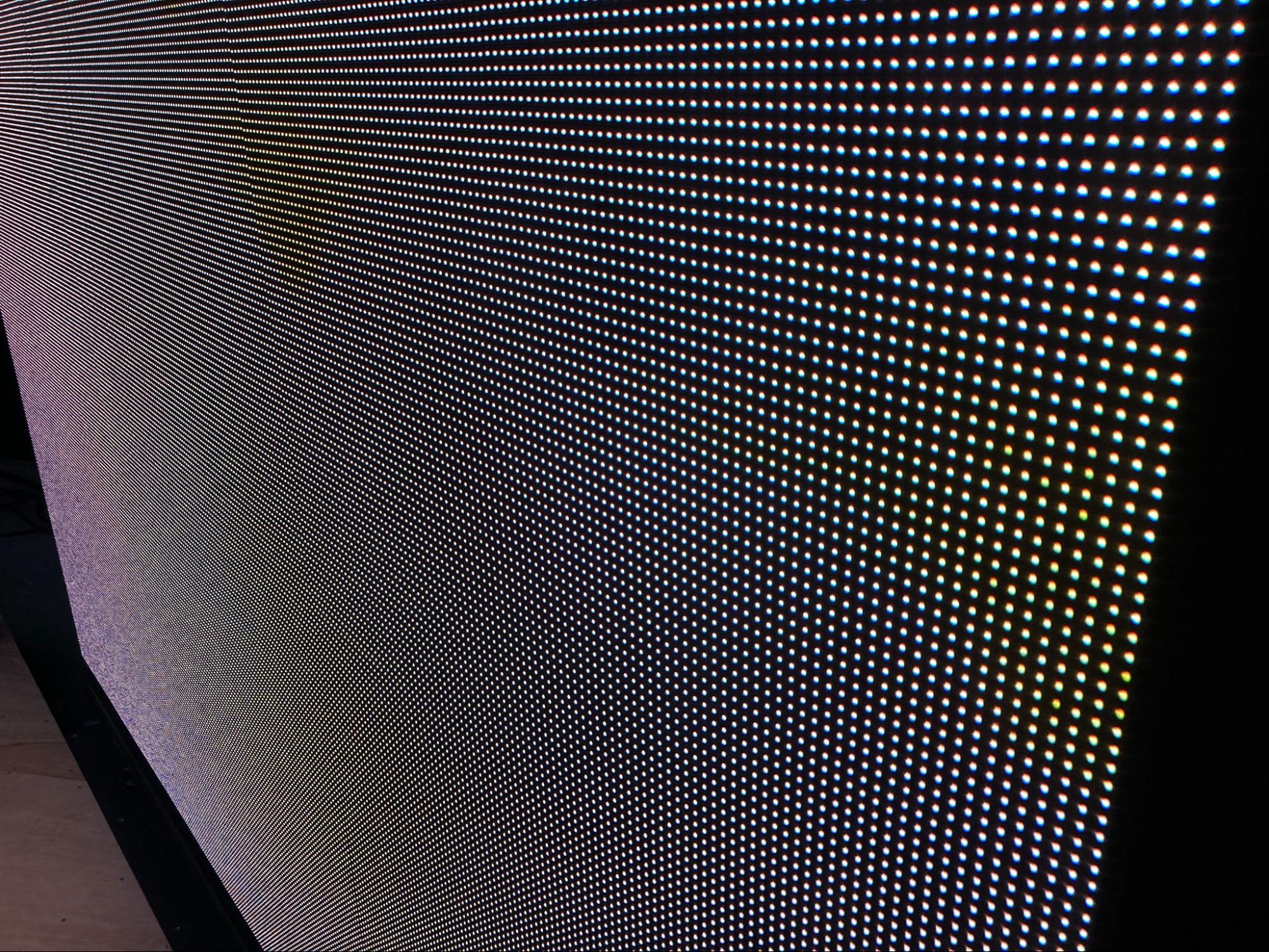

超高精細LEDディスプレイを常設したインカメラVFX撮影スタジオ。2021年7月オープン。

https://www.hibino.co.jp/topics/pdf/202105_vfxstudio.pdf(ヒビノ社 プレスリリース)

訪問

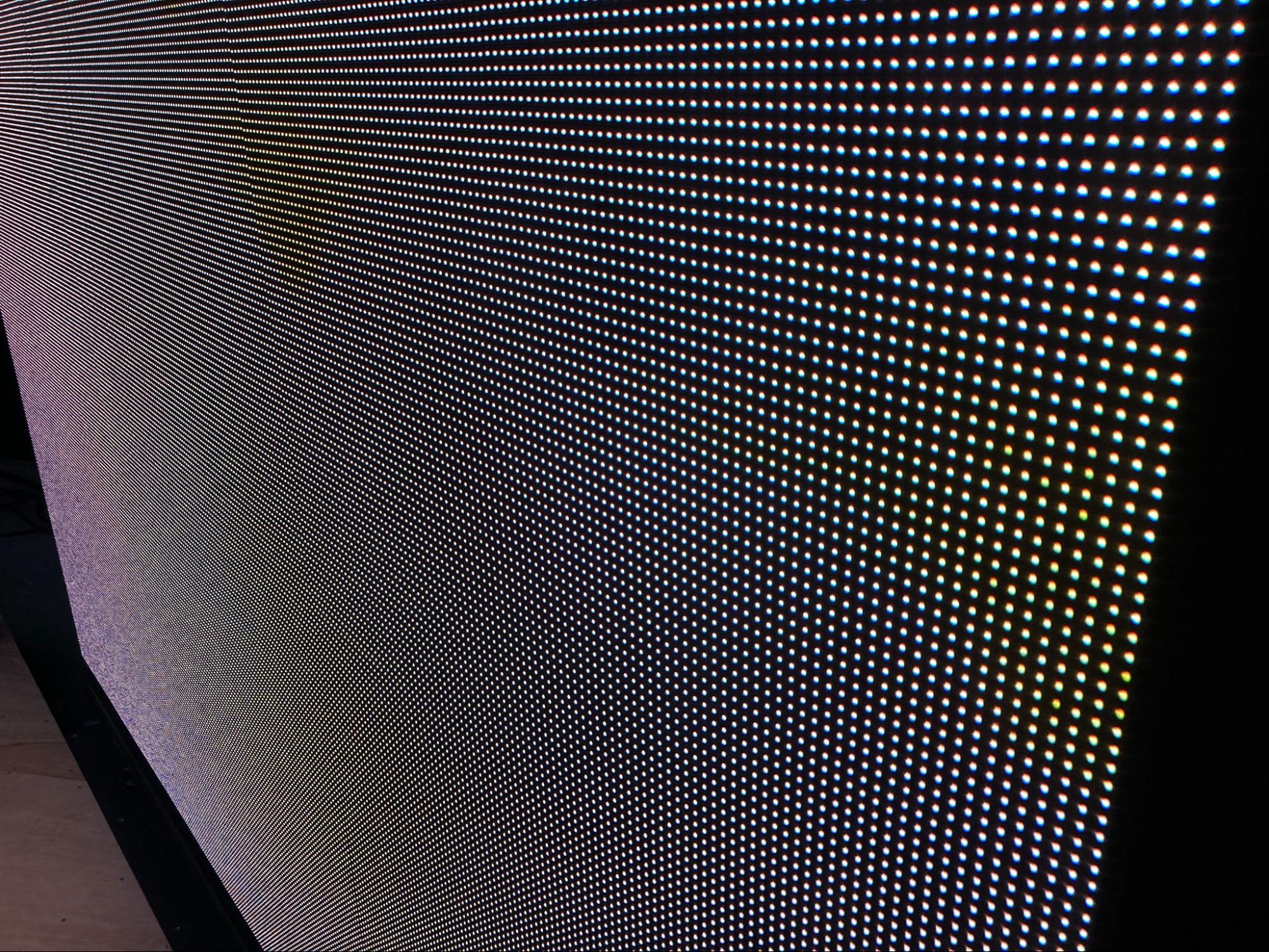

スタジオに入ると早速巨大なLEDウォールにCutting-Edge Test Driveが、

自分たちのつくったUnrealEngineのシーンが実物大で見れて感動です。

見た目も制作していたときとの差はまったくなしです。

ディスプレイの構成

LED ディスプレイは正面、天井、左右の4面

正面撮影エリア

ROE「Ruby1.5F」

全長 12m×高さ 4.5m

環境照明・天井

ROE「Carbon5」

幅 6m×奥行 3.6m

環境照明・側面X2

ROE「Carbon5」

幅 1.8m×高さ 3.6m

カメラ画角外のところは自動で解像度を下げ、環境光用として表示させることで負荷を下げるとのこと。

シーンの最適化も元のUE4のシーンからはレイトレーシングはオフしたのみで、それ以外の最適化作業をしなくても映像撮影には問題ないFPSを維持できていました。

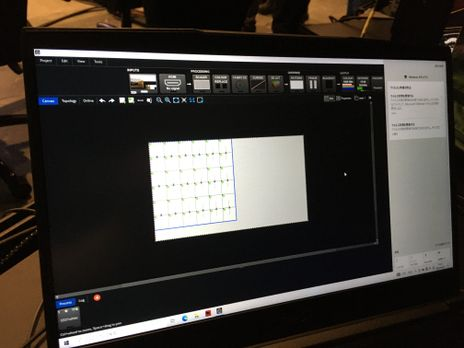

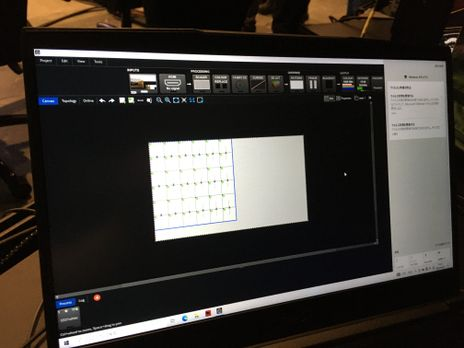

インカメラ VFX システム 映像生成・出力・収録の流れ

(1) RedSpyカメラトラッキングシステム(天井に貼られた無数の再帰反射マーカーに赤外光を投影、反射光を赤外線カメラで撮影)でリアルカメラの位置情報を特定、メディアサーバーdisguiseに伝達。

(2) disguiseからUnrealEngineマシンにカメラ情報を伝達。disguise rxIIレンダーノードでUnrealEngineレンダリング。

(3) レンダリングした映像(全景・インナーフラスタム)をdisguiseで正面・側面・天井のLEDウォールにマッピング。

(4) LEDウォール用映像を TesseraビデオウォールコントローラーでLEDパネル(個々のLEDピース)に分割表示。

(5) リアルカメラで実写+LEDウォール映像を収録。

別シーンに切り替え

街や荒野のシーンにも切り替え。

シーンの切り替え、カメラをUnrealEngineのシーンのどの位置に置くかもリアルタイムで変更できるので、役者を立たせてから、撮影場所を考えるなんてこともできそうです。

夢中になっているヒストリアの一同。

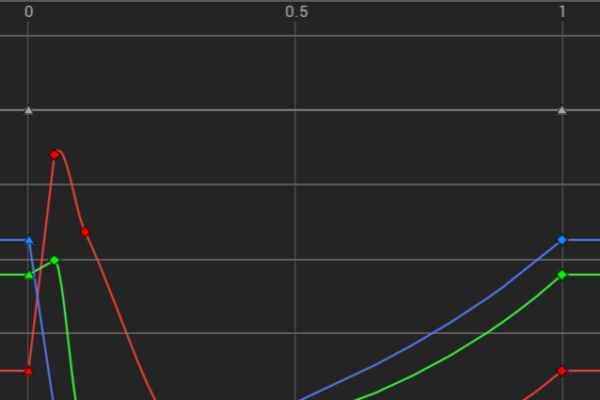

エディターでのリアルタイム反映

さらに驚いたのが、パッケージ化せずにエディターでライトやポストプロセスなどを変更できる点です。

これで実際の撮影映像を見つつリアルタイムで実写と背景をなじませることも可能です。

ライティング、マテリアルインスタンスのパラメーター、メッシュを配置し大きさも変えられ、その場で変更したものがLEDに反映されるのはエディターで作業しているのと差はなく、パラメーターを操作しだしたら楽しくてやめ時が見つかりませんでした。

気をつけるべきこと

カメラと連動して被写界深度が変化するので、あらかじめくっきりからぼけまで広い範囲で変化する前提でシーンをつくるなど、

LEDウォール用のコンテンツをつくるときの注意点も見つかりました。

岩山がカメラをぼかす前提でシーンを作っていなかったので、半透明のフォグカードの影響でぼけたときにおかしく表示されていました。

感想

インカメラVFX の LEDウォール環境照明は「ライトステージ」を、カメラのトラッキングとインナーフラスタムの描画は「Wii リモコンハック」を思い起こす技術ですが、そうした技術の積み重ね&掛け合わせが大切であることを再認識しました。(スマートフォンの急速な普及で、その構成部品の高性能化・小型化・省電力化が進んだ2010年代に、それを使ってVRヘッドセットの実用化を発案・実現した先人がいたことを思い出したりしました。)

国内のテレビドラマでも使われだし、UnrealEngineの映像コンテンツにおいて間違いなく需要が大きくなるであろうインカメラVFX。

今後はUE5のシーンにも対応予定で、NaniteやLumenと組み合わさったときどんなことになるかも期待です。

メタバース プロダクションの方々、HIBINOさん、協力してくださった皆様、ありがとうございました。

[UE5]マテリアルのSDFとは?画像から考える距離場のしくみ

2025.12.03UE

[UE5]マテリアルのSDFとは?画像から考える距離場のしくみ

2025.12.03UE

[UE5]Color CurveをMaterial Functionで設定するには

2025.04.09その他

[UE5]Color CurveをMaterial Functionで設定するには

2025.04.09その他

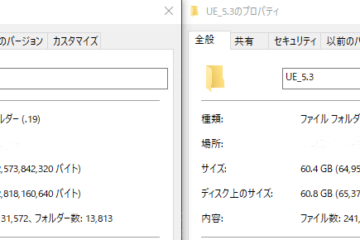

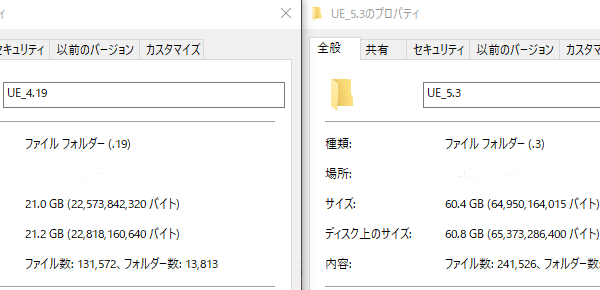

[UE4][UE5]開発環境の容量を少しでも減らす

2024.08.14UE

[UE4][UE5]開発環境の容量を少しでも減らす

2024.08.14UE